로봇 환경에서 고령자의 일상행동 인식을 위한 대규모 3D 영상 데이터셋을 소개한다.

구축 배경

고령 사회의 빠른 도래와 독거노인 가구의 급증으로 인해 고령자의 삶의 질 저하와 고령자 지원을 위한 사회 공공지출의 급격한 증가가 예상되고 있다. 이러한 사회 문제에 대한 해결책의 하나로 로봇이 고령자와 함께 생활하면서 고령자를 이해하고 정서적으로 교류하면서 상황에 맞는 건강, 생활, 인지, 정서 서비스를 제공하기 위해 필요한 로봇 지능기술의 개발이 요구되고 있다.

로봇이 휴먼에게 적절한 휴먼케어 서비스를 제공하기 위해서는 시시각각 변하는 휴먼에 대한 정보를 높은 신뢰도로 인식할 수 있는 능력이 기본적으로 필요하다. 휴먼 정보 인식 기술 중에서 휴먼이 행하고 있는 동작이 어떤 행동인지를 파악하는 행동 인식 기술은 고령자가 일생 생활에서 행하는 행위의 의도를 이해하고 고령자의 생활 패턴을 파악하기 위한 필수 기술이다.

로봇에서 활용 가능한 행동 인식 기술 중에서 활용도와 신뢰성이 가장 높은 기술은 영상 데이터를 입력으로 하는 시각기반 행동 인식 기술이며 다른 로봇 비전 기술들과 마찬가지로 최근 몇 년간 딥러닝을 통해 인식 성능이 획기적으로 향상되었다. 휴먼케어 로봇을 위한 딥러닝 기반의 행동 인식 기술의 개발을 위해서는 충분한 크기의 데이터 셋의 확보가 필수적인데 이는 쉬운 일이 아니다. 유튜브나 영화 등에서 수집된 행동들로 이루어진 기존의 데이터 셋들이 있기는 하나, 로봇환경에서 휴먼의 일상 행동을 인식하기 위한 공개 데이터 셋은 매우 부족하며 특히 고령자를 대상으로 하는 데이터 셋은 전무하다.

소개

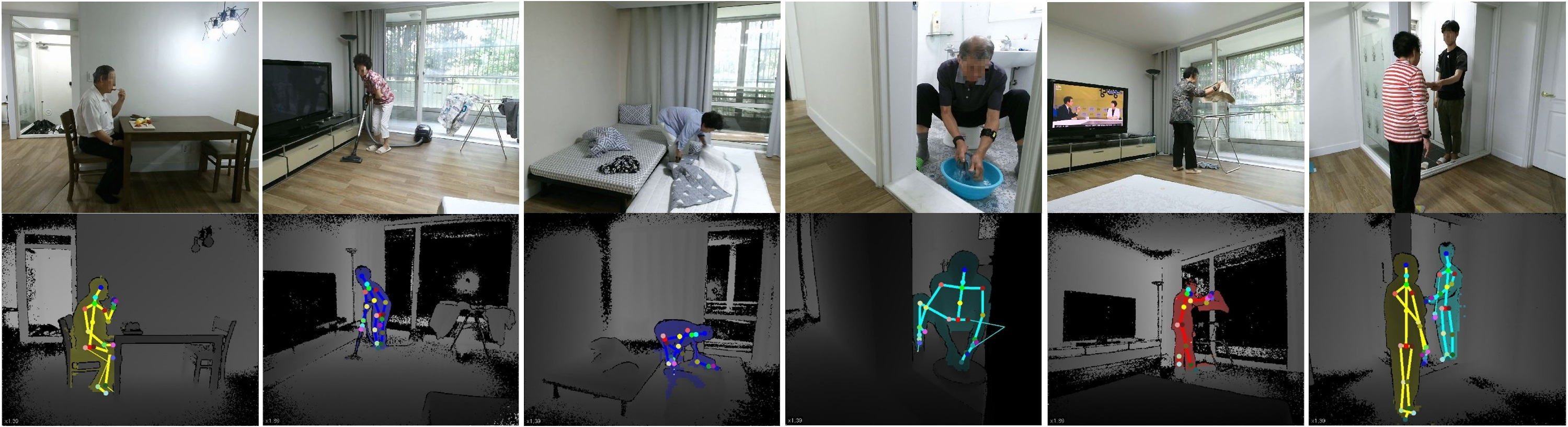

본 데이터셋은 고령자의 일상 행동을 인식할 수 있는 휴먼케어 로봇을 위한 대용량 RGB-D 데이터셋이다.

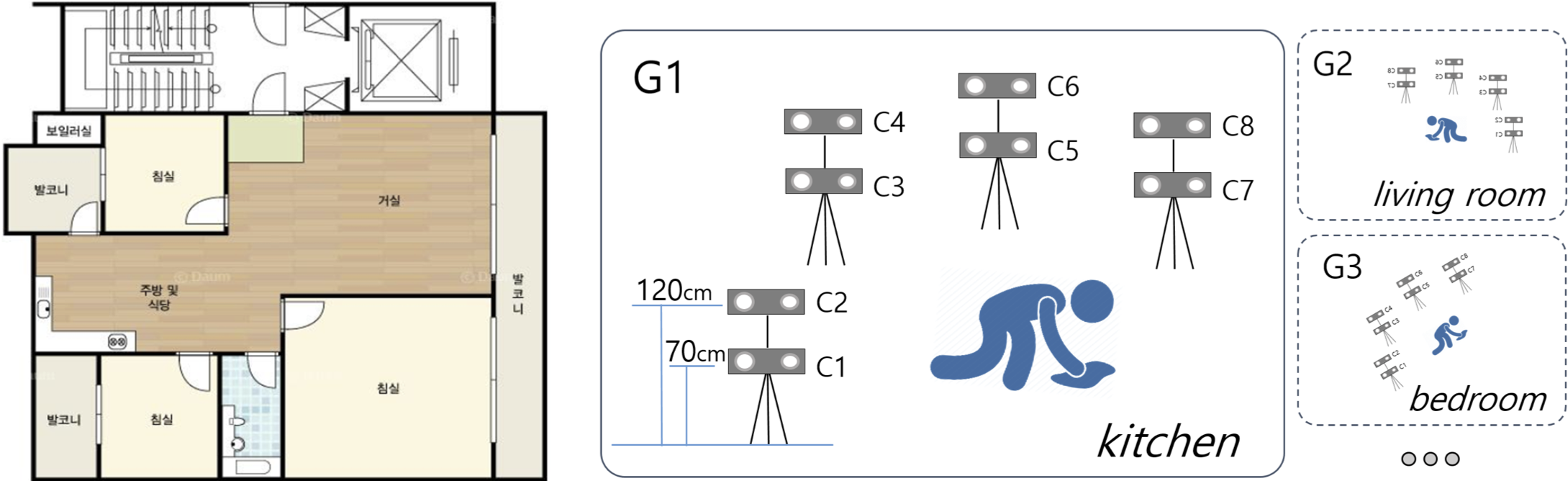

고령자가 생활하는 실제의 가정환경을 모사한 테스트베드 환경을 실제 31평형 아파트에 구축하였으며 50명의 고령자와 50명의 일반 성인으로 구성된 총 100명의 대상자를 모집하였다.

대상자가 행하는 일상행동 55종에 대하여 다양한 로봇 시점에서 Kinect v2 카메라를 이용하여 RGB 비디오, 깊이영상, 바디인덱스, 그리고 3차원 관절의 위치를 획득하였다. 최종적으로 112,620 셋의 3차원 데이터를 확보하였다.

본 데이터셋은 고령자와 로봇, 그리고 이들이 상호작용하는 환경을 종합적으로 고려한 최초의 데이터셋이며, 세계 최대 규모의 3차원 행동 인식 데이터셋이다.

본 연구진은 구축된 데이터셋이 로봇 인공지능 기술의 발전에 이바지 할 수 있기를 기대한다.

| 항목 | 내용 |

|---|---|

| 총 샘플의 개수 | 112,620 셋 |

| 인식 대상 행동 클래스 | 55개 |

| 참여자 수 | 100명 (고령자 50명, 일반 성인 50명) |

| 수집 환경 | 31평형 아파트 주거 환경 |

| 촬영 장소 | 로봇이 위치할 수 있는 다양한 장소 |

| 수집 데이터 포맷 | RGB videos, depth map frames, body index frames, 3D skeletal data |

| 촬영 카메라 | Kinect v2 |

본 데이터셋의 샘플 영상을 아래 링크에서 다운받아 볼 수 있다.

기존 데이터셋과 비교한 본 데이터셋만의 고유한 특징은 다음과 같다.

- 실제 고령자의 일상을 관찰하고 분석하여 인식 대상 행동을 선정한 실용적인 데이터셋이다.

- 휴먼케어 로봇의 서비스 상황을 고려한 현실적인 데이터셋이다.

- 고령자와 로봇을 대상으로 하는 대규모 3D 시각 데이터셋이다.

인식 대상 행동

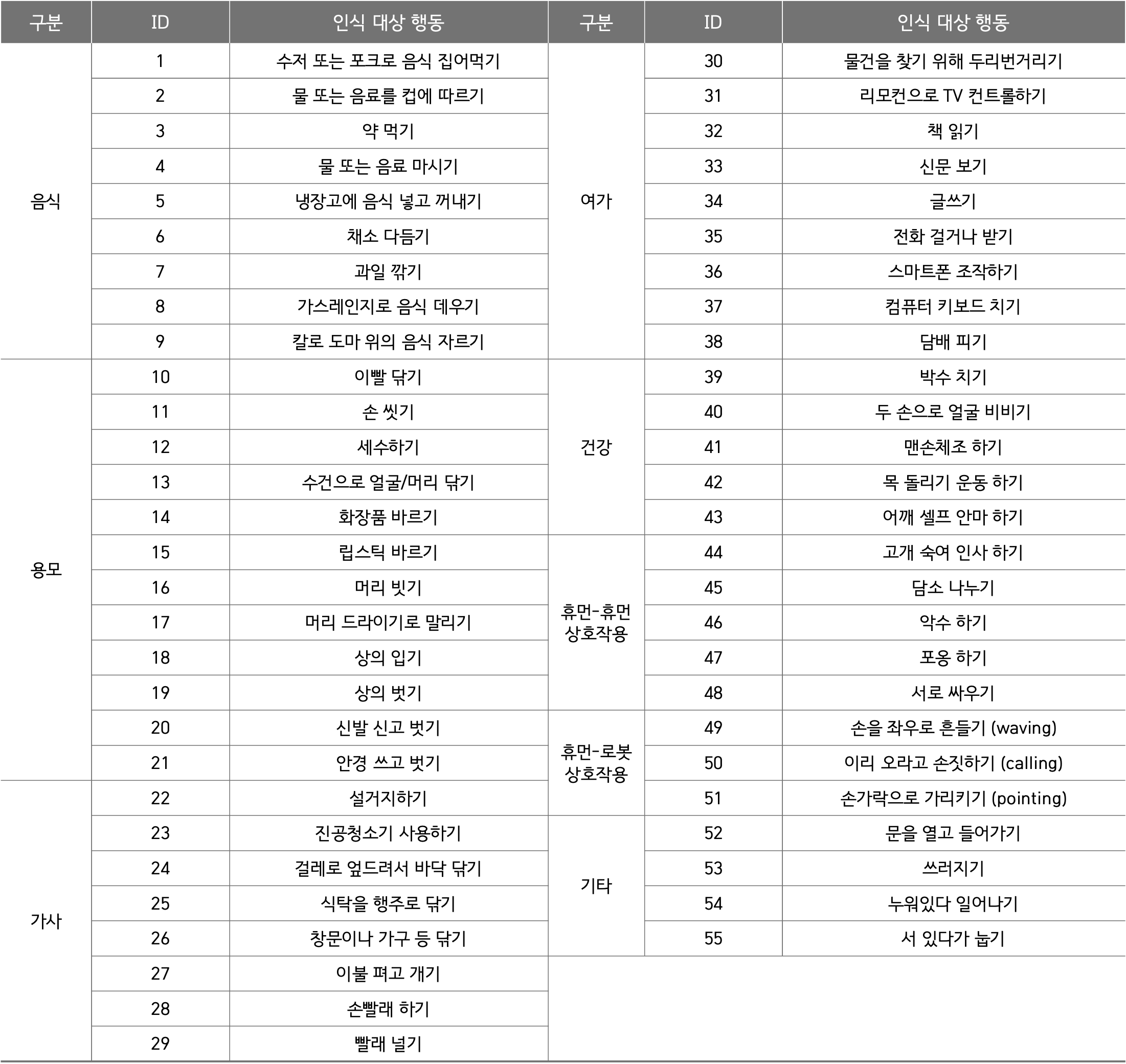

70세 이상의 고령자 53명의 자택을 방문하여 기상부터 취침까지의 하루 행동을 직접 관찰하고 기록하였더니 총 245개의 일상 활동 유형으로 압축되었다. 이들 행동 중에 빈번하게 나타나는 행동으로 TV 시청, 식사관련 활동, 화장실 사용, 식사 준비, 전화 통화, 약 복용, 요리, 청소 등이 있었으며 이러한 다빈도 활동들을 기준으로 55종의 행동을 인식 대상으로 선정하였다.

데이터 포맷

수집된 데이터는 Kinect v2 센서로 획득한 RGB 비디오, 깊이영상, 바디인텍스, 3차원 관절위치이며 동기화 되어 저장된다.

| Collected Data | Resolution | File Format | Size |

|---|---|---|---|

| RGB Videos | 1920x1080 | MP4 | 2.33TB |

| Depth Map Frames | 512x424 | PNG | 4.08TB |

| Body Index Frames | 512x424 | PNG | 42.60GB |

| 3D Skeletal Data | 25 joints | CSV | 20.83GB |

| Total | 6.47TB |

수집 환경

본 데이터셋은 로봇이 실제로 서비스하는 상황을 최대한 반영한다는 목표를 가지고 수집되었다.

가정용 서비스 로봇의 높이를 고려하여 그림 2와 같이 70cm 와 120cm 높이에 각각 Kinect v2 센서가 설치된 촬영 장비를 제작하였다. 4개의 촬영 장치를 하나의 그룹으로 형성하였으며 그룹 내 8개의 동기화된 센서가 대상자의 행동을 동시에 캡쳐한다. 촬영 장치를 고정된 간격으로 배치하는 대신 로봇이 서비스 하는 상황에서 존재할 수 있는 다양한 위치에 배치한다. 촬영 장치와 대상자의 거리는 1.5m에서 3.5m까지 다양하다. 약 먹기나 상의 입기 등 어디서나 할 수 있는 행동에 대해서는 장소를 변경해 가면서 최대 5회까지 촬영하였다. 모든 그룹과 카메라 번호는 각 비디오 샘플의 파일 이름으로 제공된다.

참조

본 데이터셋을 참조하거나 활용하시는 경우 아래의 논문을 인용해 주시기 바랍니다.

Jinhyeok Jang, Dohyung Kim, Cheonshu Park, Minsu Jang, Jaeyeon Lee, Jaehong Kim, “ETRI-Activity3D: A Large-Scale RGB-D Dataset for Robots to Recognize Daily Activities of the Elderly”, International Conference on Intelligent Robots and Systems (IROS) 2020, pp.10990-10997

다운로드

아래의 문서를 확인하여 다운로드 바랍니다.

- 가이드라인 다운로드

담당자 연락처

- 이름: 김도형 책임연구원

- 이메일: dhkim008@etri.re.kr

- 전화번호: 042-860-5873

- 소속: 한국전자통신연구원 지능로보틱스연구본부 인간로봇상호작용연구실

주의

- 본 데이터셋은 개인정보보호와 안전한 데이터의 획득/관리를 위해 기관생명윤리위원회(IRB: Institutional Review Board)의 승인을 거쳐 구축되었습니다.

- 본 데이터셋은 과학기술정보통신부 산하 정보통신기획평가원의 “고령 사회에 대응하기 위한 실환경 휴먼케어 로봇 기술 개발(2017-0-00162)” 사업의 일환으로 구축되었습니다.